1.3. API Web Audio

1.3.2. Definición de conceptos

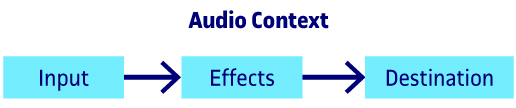

- AudioContext. Representa el entorno en el que se crea, procesa y reproduce el audio. Todos los nodos de audio deben estar vinculados a un AudioContext para funcionar.

- Nodos de audio. Los nodos de audio son los bloques fundamentales de construcción. Estos pueden ser generadores (fuentes de audio), procesadores (efectos de audio) o salidas (destinos de audio). Los nodos se conectan entre sí para formar un gráfico que define cómo fluye el audio a través de la cadena de procesamiento.

- Conexiones y enrutamiento. Los nodos de audio se conectan y desconectan entre sí utilizando métodos como

connect()ydisconnect(). Esto permite configurar cómo se procesa el audio a medida que fluye de un nodo a otro. Se puede controlar el enrutamiento y la mezcla de señales de audio de manera precisa. - Efectos y procesamiento. La API Web Audio ofrece una variedad de nodos de procesamiento que permiten aplicar efectos en tiempo real al audio. Estos nodos pueden ajustar el volumen, aplicar reverberación, filtrar frecuencias y mucho más. Se pueden combinar múltiples nodos de efectos para crear sonidos complejos.

Habitualmente el flujo de trabajo pasa por crear un contexto de audio, crear fuentes de audio de entrada, crear nodos de efectos, decidir el destino final del audio y conectar las entradas con los efectos y la salida.

Fuente: elaboración propia.